L’intelligence artificielle redéfinit le monde du travail. Partout, les entreprises font face à une transformation qui touche autant la façon de produire que de penser, de collaborer et de décider. Qui plus est, tous les pays n’avancent pas au même rythme. Selon une étude internationale couvrant 47 pays (KPMG et Université de Melbourne, 2025), le Canada se positionne au 44e rang en matière de formation et de confiance liées à l’IA.

Au Québec, les chiffres confirment l’ampleur du phénomène : l’Institut de la statistique du Québec révélait en février 2026 que 59 % de la main-d’œuvre occupe un emploi hautement exposé à l’IA, une proportion qui grimpe à 52 % chez les titulaires d’un diplôme d’études postsecondaire, et 86 % (!) pour les titulaires d’un BAC. Et dans les organisations? Il y a fort à parier que les employés utilisent déjà des outils d’IA au quotidien, souvent en dehors des solutions approuvées par l’entreprise. Face à cette réalité, comment un dirigeant peut-il agir de façon éclairée?

Pour faire le point, nous avons rencontré Jonathan Elie-Fortier, doctorant en informatique cognitive à l’UQAM. Fort d’un parcours en psychologie et en neuropsychopathologie développementale, il apporte un regard singulier sur l’intégration de l’IA en milieu de travail : un regard ancré dans la science, mais surtout centré sur l’humain.

Q1. L’IA est partout dans l’actualité. Qu’est-ce qui devrait réellement préoccuper un dirigeant d’entreprise aujourd’hui?

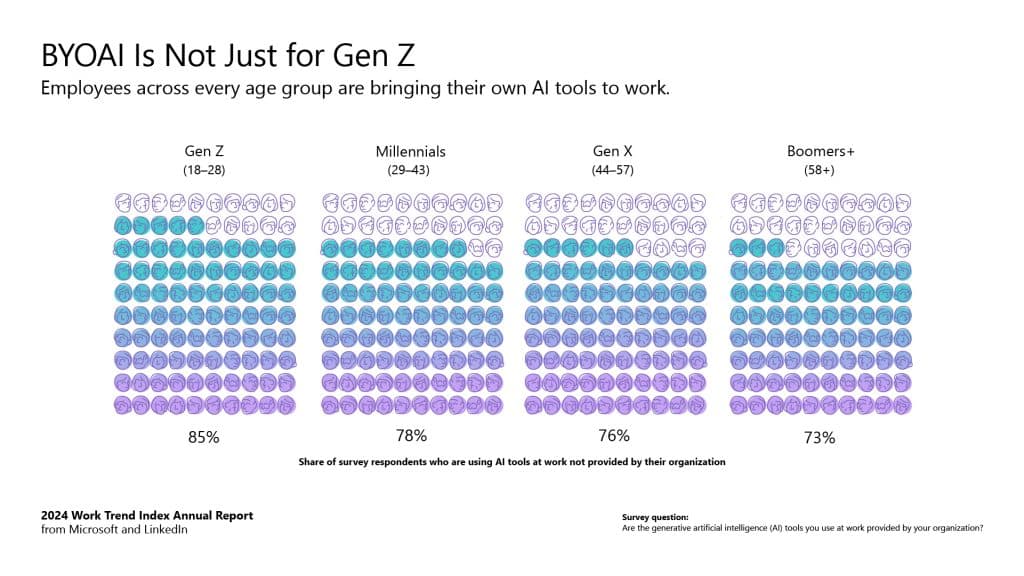

Ce qui devrait préoccuper les dirigeants, selon Jonathan, ce n’est pas tant ce que l’IA peut faire. C’est ce que leurs équipes font déjà avec elle sans cadre ni accompagnement. En s’appuyant sur le Work Trend Index 2024 de Microsoft, il souligne que l’utilisation d’outils d’IA en dehors des solutions prescrites par l’entreprise (ce qu’on appelle le shadow AI) est un phénomène transgénérationnel. De la génération Z aux boomers, les taux d’utilisation sont élevés, souvent à l’insu de l’organisation.

« Tout le monde utilise des IA à l’extérieur du fameux Copilot prescrit par une entreprise. Les travailleurs, que ce soit la génération Z, les milléniaux, la génération X et les boomers, ont des taux d’utilisation de l’IA très élevés. C’est la réalité. »

Le problème n’est pas que les employés utilisent l’IA. C’est qu’ils le font sans savoir comment bien le faire : 47% des Canadiens affirment utiliser l’IA de manière efficace, comparé à 60% pour le reste des pays sondés (KPMG et Université de Melbourne, 2025). Le risque : du copier-coller de données confidentielles dans des logiciels non sécurisés, des informations sensibles qui se retrouvent dans des systèmes sans protection adéquate. Et quand l’entreprise n’a pas de cadre clair, ces comportements passent sous le radar.

Jonathan rappelle aussi que la technologie, en soi, n’est pas le défi principal. Environ 70 % des nouvelles technologies échouent en entreprise, et dans la majorité des cas, ce sont les facteurs humains (la résistance au changement, le manque de formation, l’absence de vision partagée) qui expliquent ces échecs. L’IA ne fait pas exception.

Q2. Quels sont les risques concrets d’une mauvaise utilisation de l’IA?

Au-delà des enjeux de sécurité des données, Jonathan met en lumière un risque moins visible, mais tout aussi sérieux : l’érosion des compétences. Plusieurs publications récentes en neuropsychologie montrent que l’utilisation non encadrée de l’IA est corrélée à une réduction des capacités de résolution de problèmes, des compétences grammaticales, de la compréhension en lecture, de l’élasticité créative et du vocabulaire.

« Si on pense que l’outil va remplacer notre cerveau, puis qu’on l’utilise pour déléguer des tâches cognitives, ce n’est pas la bonne façon d’utiliser ces outils-là. »

Il cite l’exemple frappant d’un médecin qui, après seulement quatre mois de délégation cognitive à un outil d’IA, avait perdu une partie de sa finesse diagnostique. Les conséquences ne sont pas hypothétiques ni lointaines : elles se manifestent rapidement, dans le quotidien professionnel.

L’autre piège fréquent, c’est celui des hallucinations. L’IA générative peut produire des réponses qui sonnent parfaitement crédibles (ton assuré, structure logique, apparence de rigueur), mais qui sont factuellement fausses. Sans un réflexe de vérification, un employé peut propager de l’information erronée en toute bonne foi.

« L’humain dans la boucle est absolument important et non négociable. Ça prend un humain qui vient valider l’information, qui va regarder la source première, puis dire : est-ce que c’est correct, ou est-ce qu’on est dans les patates? »

Q3. Comment un dirigeant devrait-il s’y prendre pour intégrer l’IA dans ses équipes?

Devant l’effervescence médiatique entourant l’IA, Jonathan invite les dirigeants à résister à la tentation d’aller trop vite. Il emprunte une métaphore parlante au psychologue Abraham Maslow.

« Si le seul outil qu’on a est un marteau, on a tendance à voir tout problème comme un clou. Souvent, dans les médias, on entend parler de l’IA comme le fameux marteau. Et là, on veut taper partout. Ce n’est pas ce qu’il faut faire. »

L’approche qu’il préconise est structurée et progressive : commencer par un inventaire des tâches de l’équipe, y attribuer des heures, observer ce qui se passe réellement dans le quotidien du travail, puis choisir ensemble les meilleurs « clous à frapper en premier ». L’idée est de construire la confiance tranquillement, autour de la vraie réalité de l’entreprise.

Et la bonne nouvelle, souligne-t-il, c’est qu’on n’est plus à l’ère des CRM et des ERP lourds, coûteux et rigides. L’IA permet aujourd’hui d’hyper-personnaliser des solutions pour des coûts abordables, avec des outils qui restent malléables et qui évoluent avec l’équipe. Le déploiement d’un projet structuré se compte désormais en semaines, pas en mois.

« Dans le cadre de la formation, on voit vraiment ce qu’est l’outil, comment on l’utilise et quelles sont ses limites. On met la main à la pâte et on voit ce qui fonctionne. On aborde aussi le cadre légal : anonymiser, protéger les clients, protéger nos emplois. On voit tout ça ensemble. »

C’est d’ailleurs le rôle d’un accompagnement structuré : ne pas laisser le dirigeant seul devant ces choix, mais l’outiller pour avancer avec confiance.

Q4. Quels conseils pratiques donneriez-vous aux équipes qui utilisent déjà l’IA?

Jonathan propose plusieurs gestes concrets que les équipes peuvent mettre en place rapidement pour encadrer leur utilisation de l’IA.

Créer un canal de communication dédié à l’IA. Dans une équipe ou un département, un canal partagé (sur Teams, Slack ou autre) permet aux collègues d’échanger sur leurs découvertes, de se poser des questions mutuellement et de valider ensemble la fiabilité de ce que l’IA propose. C’est un geste simple qui déstigmatise l’usage et crée une culture d’apprentissage collectif.

Toujours vérifier les sources premières. Ne jamais se fier au résumé que l’IA fait d’un article ou d’une référence. Aller voir directement : est-ce que c’est un article crédible, une publication dans une revue fiable, un document officiel ? La validation passe par la source originale, pas par l’interprétation de l’outil.

Se méfier des résultats qui plaisent trop. Quand l’IA nous donne une réponse qui va exactement dans notre sens, c’est le moment de redoubler de vigilance. Un résultat qui confirme tous nos biais mérite une vérification supplémentaire, pas un copier-coller.

« Est-ce que c’est un résultat qui fait du sens, est-ce que c’est un résultat qui va aussi trop dans mon sens, qui me plaît trop? Déjà, faut avoir un peu la puce à l’oreille. »

En somme, la clé n’est pas de chercher une recette magique, mais de développer des réflexes collectifs d’esprit critique. Ces réflexes s’acquièrent par la pratique et l’accompagnement, pas par la seule intuition.

Q5. Qu’est-ce qui distingue votre approche de formation?

Le parcours de Jonathan est atypique dans le paysage des formations en IA. Doctorant en informatique cognitive avec une formation initiale en psychologie, il aborde l’IA par le prisme des facteurs humains (la pédagogie, la cognition, la résistance au changement) plutôt que par la seule technique.

Dans un marché saturé de formations en IA de qualité inégale, Jonathan se distingue par une approche centrée sur le vécu des participants. Plutôt que d’imposer un programme uniforme, il adapte ses exercices au niveau réel et au contexte professionnel de chaque personne.

« On prend les gens où ils sont, puis on va de l’avant. On va voir comment parler à ces outils, mais on va aussi s’intéresser aux enjeux transversaux qui dépassent le cadre d’un seul outil, pour se faire une bonne idée de comment avancer dans ce monde d’IA. »

L’objectif n’est pas de faire de chaque participant un expert technique, mais de l’outiller pour naviguer avec confiance et discernement dans un monde en transformation.

Comme le soulignait récemment Christina Inge, instructrice à Harvard : « Votre emploi ne sera pas remplacé par l’IA, mais il va être pris par une personne qui sait comment l’utiliser. » Jonathan en fait une conviction centrale de sa démarche.

Il conclut avec une pensée qui résume bien sa philosophie d’accompagnement.

« Comme Marie Curie le disait bien : rien dans la vie n’est à craindre, tout est à comprendre. Et cette formation, elle est pour comprendre. »

Passez à l’action : rejoindre le Parcours IA stratégique

Les enjeux soulevés par Jonathan Élie-Fortier dans cet entretien ne sont pas théoriques. Ils se vivent déjà dans les entreprises d’ici. Le Parcours IA Stratégique, offert par le Centre de formation continue du Cégep de Sherbrooke, est conçu pour y répondre concrètement.

Le parcours s’adresse aux dirigeants, cadres et responsables de transformation qui souhaitent intégrer l’intelligence artificielle dans leur organisation de façon structurée et responsable. Que vous en soyez à vos premières réflexions ou que vos équipes utilisent déjà l’IA sans cadre défini, cette certification collégiale en trois modules vous accompagne à chaque étape.

Entièrement offerte en ligne, cette certification collégiale est composée des trois modules suivants :

- Module 1 : Poser les bases de l’IA – 7 séances

- Module 2 : Adopter l’IA de façon éthique – 6 séances

- Module 3 : Déployer l’IA avec impact – 7 séances

L’inscription se fait directement en ligne. Les places étant limitées, il est conseillé de s’inscrire rapidement.

Pour toute question, l’équipe de la formation continue est disponible pour vous orienter.

Profil d’expert

Jonathan Elie-Fortier

Jonathan Elie Fortier allie une formation en psychologie aux recherches doctorales qu’il mène actuellement en informatique cognitive à une solide expérience entrepreneuriale. Cette double expertise lui permet de créer des approches pédagogiques innovantes qui rendent l’intelligence artificielle accessible et concrète. Chercheur et praticien, il conçoit des formations adaptées aux profils d’apprentissage et aux réalités des PME, en mariant rigueur scientifique et applications pratiques.